Technológiai riporter

Getty Images

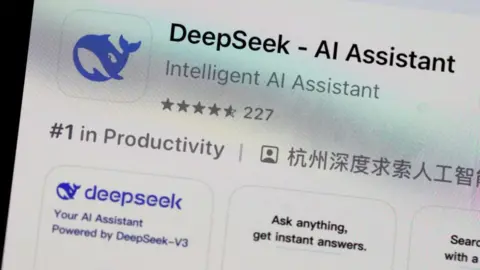

Getty ImagesEd Husic, Ausztrália tudományos minisztere lett az első nyugati kormánytag, aki adatvédelmi aggályokat fogalmazott meg a DeepSeek, a kínai chatbot miatt, amely felfordulást okoz a piacokon és a technológiai iparban.

A Huawei-től a TikTok-ig terjedő kínai technológiai megoldásokról többször is elhangzottak olyan vádak, amelyek szerint a cégek kapcsolatban állnak a kínai állammal, és félő, hogy ez az emberek adatainak hírszerzési célú begyűjtéséhez vezethet.

Donald Trump szerint a DeepSeek egy “ébresztő hívás” az Egyesült Államok számára, de úgy tűnt, hogy ez nem jelent veszélyt a nemzetbiztonságra – ehelyett azt mondta, hogy ez még jó is lehet, ha csökkenti a költségeket.

Husic azonban kedden az ABC Newsnak elmondta, hogy még sok megválaszolatlan kérdés maradt, többek között az “adatok és a magánélet kezelése” kapcsán.

“Nagyon óvatos lennék ezzel kapcsolatban, az ilyen típusú kérdéseket alaposan mérlegelni kell” – tette hozzá.

A DeepSeek nem válaszolt a BBC megkeresésére – de az Egyesült Királyságban és az Egyesült Államokban a felhasználók eddig nem mutattak ilyen óvatosságot.

A DeepSeek mindkét országban az alkalmazásboltok élére ugrott, a Sensor Tower piaci elemzői szerint a piacra kerülés óta 3 millió letöltés történt.

Ennek 80%-a az elmúlt héten érkezett, ami azt jelenti, hogy háromszor olyan gyorsan töltötték le, mint a riválisok, például a Perplexity.

Milyen adatokat gyűjt a DeepSeek?

A DeepSeek szerint saját adatvédelmi szabályzatának, nagy mennyiségű személyes adatot gyűjt a felhasználóktól, amelyeket aztán “biztonságos szervereken” tárolnak Kínában.

Ez magában foglalhatja a következőket:

- A fiók létrehozásakor megadott e-mail cím, telefonszám és születési dátum.

- Bármilyen felhasználói bevitel, beleértve a szöveget és a hangot, valamint a csevegési előzményeket.

- úgynevezett “technikai információk” – a telefon modelljétől és operációs rendszerétől kezdve az IP-címén át a “billentyűleütési mintákig”.

Azt állítja, hogy ezeket az információkat a DeepSeek fejlesztésére használja fel a “biztonság, a biztonság és a stabilitás” fokozásával.

Ezt követően megosztja ezeket az információkat másokkal, például szolgáltatókkal, hirdetési partnerekkel és a vállalatcsoportjával, amelyeket “a szükséges ideig” megőriz.

“Valódi aggályok merülnek fel a DeepSeek technológiai potenciáljával kapcsolatban, különös tekintettel az adatvédelmi irányelvek feltételeire” – mondta Lauren Hendry Parsons, az ExpressVPN digitális adatvédelmi szószólója.

Külön kiemelte a szabályzat azon részét, amely szerint az adatok felhasználhatók “az Ön és a szolgáltatáson kívüli tevékenységeinek összevetésére” – ami szerinte “azonnal meg kell kongatni a vészharangot mindazok számára, akik aggódnak az adatvédelmük miatt”.

De bár az alkalmazás rengeteg adatot gyűjt, a szakértők rámutatnak, hogy ez nagyon hasonló az adatvédelmi irányelvekhez, amelyekbe a felhasználók már beleegyezhettek olyan rivális szolgáltatások esetében, mint a ChatGPT és a Gemini, vagy akár a közösségi médiaplatformok.

Tehát biztonságos?

“Bármely nyíltan elérhető, webes vagy applikációs felülettel rendelkező mesterséges intelligencia modell esetében – beleértve, de nem kizárólagosan a DeepSeek-et – a kérések vagy a mesterséges intelligenciának feltett kérdések a modell készítői számára is elérhetővé válnak, ahogyan a válaszok is” – mondta Emily Taylor, az Oxford Information Labs vezérigazgatója.

“Tehát mindenkinek, aki bizalmas vagy nemzetbiztonsági területeken dolgozik, tisztában kell lennie ezekkel a kockázatokkal” – mondta a BBC-nek.

Dr. Richard Whittle, a Salfordi Egyetem munkatársa elmondta, hogy az alkalmazással kapcsolatban “különböző aggályai vannak az adatokkal és a magánélet védelmével kapcsolatban”, de elmondta, hogy az Egyesült Államokban használt modellekkel kapcsolatban is “rengeteg aggály” merült fel.

“A fogyasztóknak mindig óvatosnak kell lenniük, különösen a hype és a félelem miatt, hogy lemaradnak egy új, rendkívül népszerű alkalmazásról” – mondta.

Az Egyesült Királyság adatvédelmi szabályozó hatósága, az Információs Biztos Hivatala sürgette a nyilvánosságot. hogy ismerje meg a jogait a mesterséges intelligenciamodellek képzéséhez felhasznált adataikról.

A BBC News kérdésére, hogy osztja-e az ausztrál kormány aggodalmait, a vállalat közleményében azt mondta: “A generatív mesterséges intelligencia fejlesztőinek és alkalmazóinak biztosítaniuk kell, hogy az emberek értelmes, tömör és könnyen hozzáférhető tájékoztatást kapjanak személyes adataik felhasználásáról, valamint világos és hatékony eljárásokat kell alkalmazniuk, hogy az emberek gyakorolhassák információs jogaikat.

“Továbbra is együttműködünk az érdekelt felekkel a hatékony átláthatósági intézkedések előmozdítása érdekében, nem riadva vissza a fellépéstől, ha szabályozási elvárásainkat figyelmen kívül hagyják.”

Forrás (BBC) – angol nyelven.